En tapant les mots « ZDNet superb reporting » dans le programme d’IA GauGAN 2 de Nvidia, on obtient automatiquement des images surréalistes. Tiernan Ray/ZDNet/Nvidia

Tapez les mots » ZDNet superb reporting » dans la nouvelle démo d’intelligence artificielle de Nvidia, GauGAN 2, et vous verrez apparaître une image de ce qui ressemble à de gros morceaux de mousse isolante se débattant dans un lac sur fond de neige.

Ajoutez d’autres mots, comme « ZDNet superb reporting comely », et vous verrez l’image se transformer en quelque chose de nouveau, une forme à peine reconnaissable, peut-être une voiture de course de Formule 1 qui a été digérée, avançant sur ce qui ressemble à une route, devant des vues floues d’une structure artificielle.

GauGAN 2 produit une interprétation étrange de la phrase « ZDNet superb reporting comely ». Tiernan Ray/ZDNet/Nvidia

Lancez les dés, avec un petit bouton d’une image de deux dés, et vous et la même phrase devient un paysage effrayant, enveloppé de brume, avec une bouche béante d’une sorte de nature organique, mais complètement non identifiable quant à son espèce exacte.

Un autre lancer de dés produit ce paysage bizarre plus une créature. Tiernan Ray/ZDNet/Nvidia

Taper des phrases est une des façons de contrôler GauGAN, un algorithme développé par le géant des puces graphiques Nvidia pour présenter l’état de l’art de l’IA. Le programme GauGAN original a été introduit début 2019 comme un moyen de dessiner et de voir le programme générer automatiquement une image photo-réaliste.

Le terme « GAN » dans le nom fait référence à une vaste classe de programmes de réseaux neuronaux, appelés réseaux antagonistes génératifs (Generative Adversarial Network), introduits en 2014 par Ian Goodfellow et ses collègues. Les GAN font appel à deux réseaux neuronaux fonctionnant en opposition, l’un produisant une sortie qu’il affine régulièrement jusqu’à ce que le second réseau neuronal la qualifie de valide. La nature compétitive de ce va-et-vient explique pourquoi on les appelle « adversarial ».

Nvidia a réalisé un travail de pionnier en étendant les GAN, notamment en introduisant en 2018 le « Style-GAN », qui a permis de générer de fausses photos de personnes très réalistes.

Dans le GauGAN original de 2019, Nvidia utilise une approche similaire, permettant de dessiner un paysage sous forme de zones, connues sous le nom de carte de segmentation. Ces abstractions de haut niveau, comme les lacs, les rivières et les champs, deviennent un modèle structurel, et le programme GauGAN remplit alors la carte de segmentation dessinée avec des formes du monde réel.

La deuxième version du programme a été mise à jour pour prendre en charge le langage. L’objectif est de faire en sorte que GuaGAN 2 soit sollicité par des phrases sensées, des éléments relatifs aux paysages, tels que « côte, reliefs, falaises ». Le programme GauGAN 2 répondra en générant une scène d’apparence réaliste qui correspond à cette entrée.

Selon Nvidia, le programme a été développé dans sa phase « d’entraînement » en recevant 10 millions d’images de paysages de haute qualité, à l’aide du superordinateur Selene construit à partir de GPU Nvidia.

Une carte de segmentation peut également être créée automatiquement, ce qui permet de revenir en arrière et de modifier la disposition du paysage, de la même manière que l’original GauGAN permettait de le faire.

Comme Nvidia décrit GauGAN 2 dans un article de blog, la combinaison du texte, de l’image et de la carte de segmentation constitue une avancée majeure dans le domaine de l’IA multimodale :

GauGAN2 combine la cartographie de segmentation, l’inpainting et la génération de texte-image dans un seul modèle, ce qui en fait un outil puissant pour créer un art photoréaliste avec un mélange de mots et de dessins. Cette démo est l’une des premières à combiner plusieurs modalités – texte, segmentation sémantique, croquis et style – dans un seul cadre GAN. Il est ainsi plus rapide et plus facile de transformer la vision d’un artiste en une image générée par l’IA de haute qualité.

L’avantage pratique, selon Nvidia, est que l’on peut utiliser quelques mots pour obtenir une image de base sans aucun dessin, puis peaufiner les détails pour affiner le résultat final.

Mais l’ajout de mots qui n’ont rien à voir avec les paysages, comme « ZDNet », commence à générer des artefacts délirants. Dans la terminologie de l’apprentissage profond, les images bizarres produites par des phrases absurdes sont le résultat du fait que le programme doit se battre avec un langage « hors distribution », c’est-à-dire non capturé dans les données d’apprentissage qui ont été fournies à la machine. Face à des phrases inconciliables, le programme s’efforce de faire correspondre une image à la phrase.

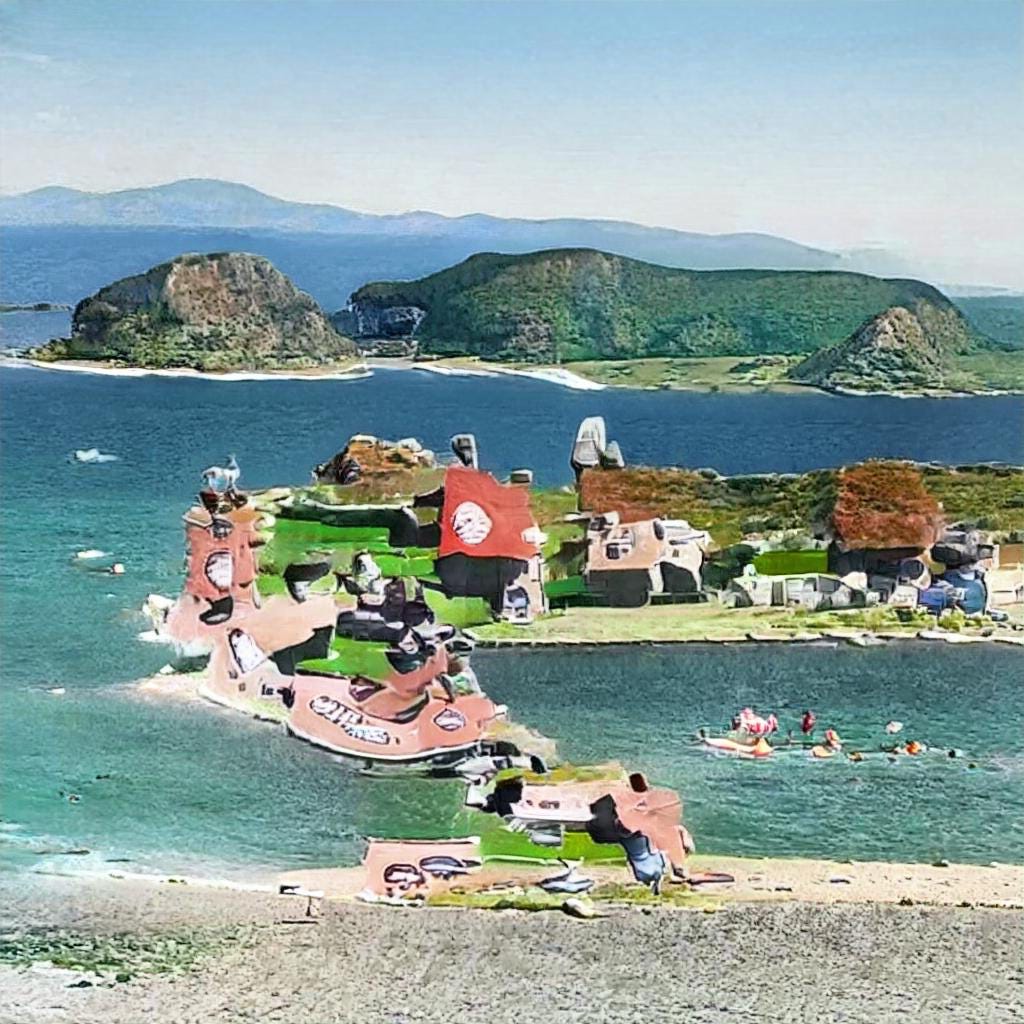

Comme on peut le voir dans une série d’images, « coast ripples cliffs » produit d’abord une image très fidèle. L’ajout de qualificatifs avec des mots impertinents – vélo, ville de New York, le nom de Cassandra – commence à déplacer et à façonner le paysage de manière étrange.

Sortie automatique par GauGAN2 de la phrase « coast ripples cliffs ».

Tiernan Ray/ZDNet/Nvidia

Sortie automatique par GauGAN2 de la phrase « coast ripples cliffs bicycle New York Cassandra drill airplane wisely pneumatic ostentatious ». Tiernan Ray/ZDNet/Nvidia

Des choses encore plus intéressantes se produisent lorsque tous les mots du paysage sont supprimés, ne laissant que les non-sens. Des paysages étranges et futuristes, ou des amibes multicolores apparaissent.

Sortie automatique par GauGAN2 pour la phrase « Cassandra-drill-airplane wisely pneumatic ostentatious ».Tiernan Ray/ZDNet/Nvidia

Sortie automatique par GauGAN2 pour le mot « ostentatoire ».

Tiernan Ray/ZDNet/Nvidia

Sortie automatique par GauGAN2 pour le mot « ostentatoire ».

Tiernan Ray/ZDNet/Nvidia

Sortie automatique par GauGAN2 pour la phrase « wisely pneumatic ostentatious ».

Tiernan Ray/ZDNet/Nvidia

Sortie automatique par GauGAN2 pour la phrase « sagement pneumatique ostentatoire ». Tiernan Ray/ZDNet/Nvidia

L’expérience peut être poussée encore plus loin avec des phrases étendues qui sont suggestives sans être exactement descriptives. Essayez d’introduire le premier vers du poème de T.S. Eliot The Wasteland, « April is the cruellest month, breeding lilacs out of the dead land. « .

Il en résulte des images saisissantes qui sont, en fait, assez appropriées. En lançant les dés, de nombreuses variantes de paysages appropriés apparaissent, avec seulement de légers artefacts dans certains cas.

« Avril est le mois le plus cruel, il fait pousser des lilas hors de la terre morte », T.S. Eliot, The Wasteland.

Tiernan Ray/ZDNet/Nvidia

Grâce aux innovations de StyleGAN, GauGAN est capable d’appliquer un style à l’image, afin de conditionner la sortie à la forme d’une autre image, un peu comme un mash-up.

L’application du style au poème d’Eliot déforme les images fidèles du paysage au point de les rendre méconnaissables. Une fois de plus, toute une série d’objets étranges apparaissent, certains ayant une qualité organique écoeurante, d’autres n’étant que des fragments de ce qui était autrefois une image.

Tiernan Ray/ZDNet/Nvidia

Tiernan Ray/ZDNet/Nvidia

Tiernan Ray/ZDNet/Nvidia

On peut également soumettre des images et même dessiner sur GauGAN 2. L’envoi d’une vieille photographie prise à Þingvellir, le site de l’ancien parlement islandais, n’a pas donné grand-chose. L’image n’a pratiquement pas été transformée, selon des tests limités.

Une photo prise à Þingvellir, le site de l’ancien parlement islandais, n’a pratiquement pas été modifiée lorsqu’elle a été soumise à GauGAN2. Tiernan Ray

L’ajout du mot » Þingvellir » a toutefois permis d’obtenir un paysage suffisamment réaliste et conforme au site de Þingvellir.

La sortie de GuaGAN2 pour le mot » Þingvellir » était dans l’esprit de l’ancien paysage islandais. Tiernan Ray/ZDNet/Nvidia

En ajoutant le mot « volcan », on obtient un autre paysage saisissant, moins réaliste, plus surréaliste.

Sortie automatique de GuaGAN2 pour « Þingvellir-volcano ». Tiernan Ray/ZDNet/Nvidia

L’ajout d’un mot impertinent, tel que » Technologie « , a encore bousculé le paysage, ajoutant d’étranges figures absurdes.

Sortie automatique de GauGAN2 pour la phrase « technologie Þingvellir ». Tiernan Ray/ZDNet/Nvidia

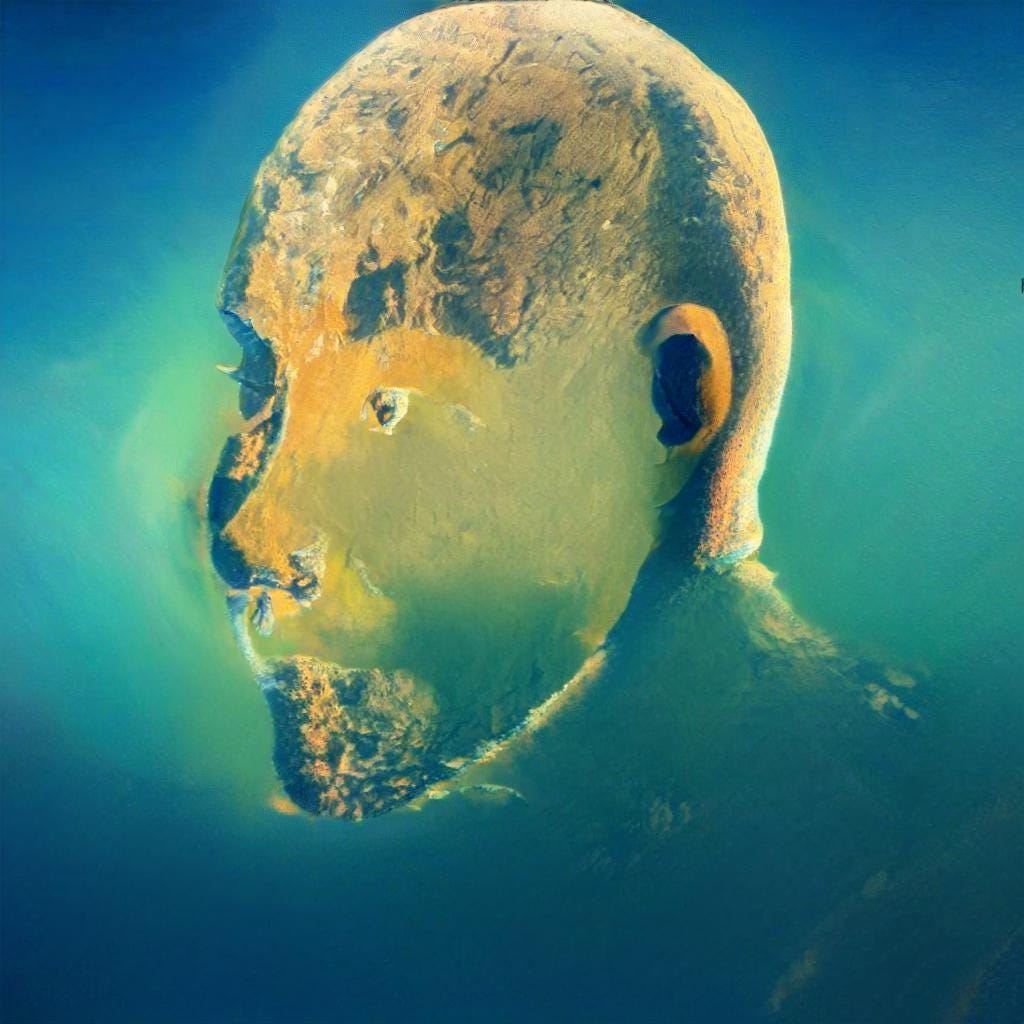

Plutôt que de soumettre une photo d’un paysage, on peut dessiner, comme c’était le cas dans le GauGAN original. Là encore, choisir quelque chose qui ne correspond pas à la démo, un dessin non pas d’un paysage mais de la tête d’une personne, donne des résultats plus intéressants. Le visage peut être re-skinné, si vous voulez, en utilisant la fonction mash-up. En lançant les dés, on obtient des variations intéressantes.

dessin directement dans GauGAN2. Tiernan Ray/ZDNet/Nvidia

Dessin d’une tête relookée en utilisant la fonctionnalité des couches dans GauGAN2. Tiernan Ray/ZDNet/Nvidia

Dessin d’une tête redessinée à l’aide de la fonctionnalité des couches de GauGAN2. Tiernan Ray/ZDNet/Nvidia

La combinaison du dessin avec le mot « Þingvellir » a produit des changements subtils, tout comme l’ajout de mots supplémentaires tels que « volcan » et « rift ». L’image a été remaniée pour avoir une sorte de texture semblable à celle d’un volcan.

Dessin d’une tête combiné avec les mots » Þingvellir volcano rift » et réécrit en utilisant la fonctionnalité des couches dans GauGAN2. Tiernan Ray/ZDNet/Nvidia

Notez que l’interface utilisateur de l’application peut être difficile à faire défiler dans les navigateurs d’ordinateur de bureau. Pour une raison quelconque, elle semble mieux fonctionner dans un navigateur de tablette, comme un iPad.

Source : « ZDNet.com »